La “Realidad Virtual” se popularizó desde mediados de los años 80 por un gran número de seguidores de la ciencia ficción. Aunque el término como acepción data de finales de los años 30, la popularización de la informática y el incremento en la capacidad de cálculo de las máquinas permitió a científicos y entusiastas vislumbrar un futuro donde el hombre sería capaz de crear una realidad alternativa donde jugar, vivivir y experimentar.

Los años pasaron y la realidad virtual se quedó encasillada en determinados contextos académicos o científicos, cosechando un nulo éxito en campos (a priori) tan interesantes para esta tecnología como los videojuegos, el hogar, el cine…

Apenas recién entrados los años 90, un empleado de Boeing acuñó el término “Realidad Ampliada” (también conocida como “Realidad Aumentada”) mientras ensamblaba diversos cables en un avión, pensando que sería estupendo tener más información en el mundo real, que pudiese ayudarlo a distinguir esos cables de otros.

Y es que quizás, la informática se equivocó de enfoque cuando pretendía crear realidades digitales: Fuimos tan valientes de soñar con mundos creados desde cero por ordenadores nacidos de una industria recién creada, cuando en realidad lo que nos era realmente útil era lo inverso… ver en el mundo real toda esa información contenida en las máquinas.

Entonces llega el momento en el que la tecnología se alinea con el pensamiento de expandir la realidad que nos rodea (y no crear otra nueva)... Y es cuando entonces, ahora, asistimos al nacimiento de algo que – en mi opinión – se convertirá en el futuro de cualquier dispositivo móvil que llevemos en nuestros bolsillos. O incluso los ordenadores y portátiles que manejamos día a día.

Un catálogo silencioso

Muchos de los entusiastas de la Realidad Ampliada dirán que esta tecnología era algo que debería nacer tarde o temprano, por la misma inercia de la industria que mueve la sociedad de la información. Y es precisamente esta sociedad, la de la información, la que ha creado un cultivo de datos digitales sembrados a diestro y siniestro por todo el mundo (próximamente el espacio), que esperan invisiblemente “algo” que sea capaz de “hacerlos visibles”.

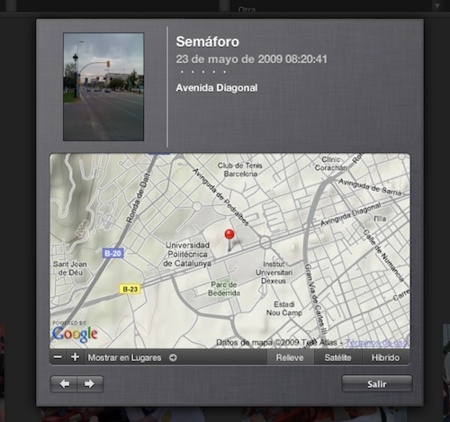

Llevamos años poniendo etiquetas al mundo que nos rodea, aunque no nos demos cuenta. Desde el tradicional método de describir las fotos que tomamos digitalmente con palabras claves en nuestro ordenador (“París”, “Louvre”... bastarían como método simplificado de “geolocalización”, en iPhoto o Picasa, por ejemplo) hasta utilizar los modernos chips GPS que prácticamente ya encontramos en muchos móviles y que se empiezan a incorporar a cámaras digitales o tarjetas de memoria.

Pero no sólo ocurre de esta forma. Durante años, se han recopilado direcciones físicas de establecimientos, museos, metro, puntos de interés turístico en decenas de libros y guías. En algún punto de éstos últimos diez años, estas guías se han digitalizado y esta información “familiar” puede traducirse, automáticamente, en coordenadas GPS precisas como nunca y que sitúan en la realidad lo que antes era mera información “de consulta”.

Por tanto, ya tenemos la información convertida en una capa latente de datos, oculta entre el entramado de Internet y preparada para ser “desenterrada”. Sólo nos falta algo para completar esta primera etapa primigenia de evolución: los dispositivos. Y aquí es donde empieza la parte divertida.

El pequeño camino de una idea

A pesar de que Apple no incluyó en el primer iPhone ningún chip compatible con el sistema de posicionamiento global GPS, comenzó a desarrollar en su iPhone OS un sistema que, mediante triangulación de las antenas de telefonía móvil y la información ofrecida por las operadoras de Internet, conseguía situar con una precisión razonablemente exacta un punto en el mapa de la Tierra.

Pronto nació el iPhone 3G y con él, la llegada del GPS al móvil de Apple. Es curioso, cuando mucha gente veía en esta nueva funcionalidad una simple característica más de “navegación” por Google Maps, o la preparación del dispositivo para un inminente lanzamiento de navegador “turn-by-turn” (como Navigon MobileNavigator o Tom Tom), algunos mirábamos de reojo un campo muy atractivo y prácticamente virgen en los dispositivos portátiles: La Realidad Ampliada.

Sólo era algo potencialmente útil, pero sin mucha explotación aún por parte de la comunidad de desarrollo. Pero llegó la brújula digital en el iPhone 3G S. Y de nuevo, muchos sólo vieron otra forma de navegar “mejor” por los programas de siempre, y otros pensamos que por fin, el momento de comunión entra la cantidad de información y el hardware adecuado había alcanzado la perfecta comunión.

La brújula es, en un sistema GPS, quien define el vector director de un punto geolocalizado. En el iPhone 3G, tenemos ese punto geolocalizado, pero el sistema no es capaz de saber “hacia donde está mirando”, excepto si se mueve, momento en el que calcula de forma sencilla la dirección del movimiento. Pero no en reposo, cosa que la brújula captura cada pequeño giro, con lo que tenemos el sistema perfecto para “navegar” por esta realidad digitalmente mejorada.

¿Pero cómo serían estas primeras aplicaciones de la Realidad Ampliada cuando no hay pasado histórico sobre nada parecido?

Abriendo los ojos, poco a poco

La primera visión de los dispositivos hacia la Realidad Ampliada puede calificarse, sin duda, de exploración. Exploración de posibilidades, se entiende. Todos saben que la información está ahí, que el dispositivo la puede leer, pero ahora hay que ver qué queremos mostrar y cómo la queremos representar.

La Realidad Ampliada no es más que la visión de unos datos digitales representados sobre imágenes reales del mundo de nuestro alrededor, actualizada sobre ellas en tiempo real. Esto quiere decir que, si utilizamos nuestro iPhone con la fantástica aplicación de accroshair para encontrar información sobre el metro de Nueva York, enfocando a nuestro alrededor con el dispositivo, veremos datos procedentes de Internet tal y como si estuvieran “flotando” en la realidad:

Precisamente mientras escribía este artículo, me he encontrado un gigantesco banner en la App Store en el que acrossair presenta su “pack” de aplicaciones de Realidad Aumentada para distintos sistemas de transporte (ojo, que Madrid y Barcelona ya tienen aplicación).

También es interesante que le echéis un vistazo a NearestWiki, también de acrossair, donde la aplicación nos muestra en una vista de Realidad Ampliada la información cercana sobre monumentos, lugares y sucesos a donde estemos. Eso sí, sólo funcionará en los iPhone 3G S (necesita la brújula digital para localizar precisamente las coordenadas).

El “problema” del sistema es que la información no está asentada en una sola fuente. A menudo se encuentra sesgada entre diversos lugares de Internet, y es lógico pensar que a largo plazo dicha información se irá combinando. Quizás, como lo hace Bionic Eye, una nueva aplicación de la App Store con nombre futurista que muestra información no sólo de transportes, sino de restaurantes, puntos de interés turístico, hoteles, cafeterías, tiendas…

Correr antes que gatear

La Realidad Ampliada no ha surgido antes debido a la necesidad de una buena capacidad de cálculo para desplazar y mostrar la información en tiempo real sobre un vídeo procesado al instante. Sin embargo, a veces hay que aprender a correr antes que andar para que las cosas sucedan más deprisa.

El reconocimiento de objetos por parte de las computadoras es uno de los campos más difíciles (y apasionantes) de la informática moderna. Algo tan simple y que hacemos millones de veces a diario, como reconocer cientos de objetos sin darnos cuenta, a una máquina le cuesta mucho.

¿Cómo definiríais una “mesa”? ¿Cómo conseguiríamos que una máquina reconozca no una mesa, sino cualquier mesa, a partir de unas imágenes que jamás ha visto desde cientos de ángulos distintos? Y sólo estamos empezando: Imaginaos con objetos más complejos.

Pero sin gatear aún en este nuevo mundo, hemos empezado a correr: Inciativas como el SREngine, del japonés Sein Kanemura, se perfilan como uno de los pasos mejor orientados hacia el futuro que nos espera: El reconocimiento de objetos en escenas y la superposición de información extraída de ellos. Como ya os había dicho, esto es correr antes que gatear. Lo mejor de todo es que ya tenemos algo que funciona en un iPhone…

La tecnología de Kanemura utiliza una mezcla de aplicación cliente/servidor para repartir la carga de procesamiento entre el iPhone y un ordenador remoto que es el que “realmente” analiza la imagen. Sin embargo, también utilizan técnicas de procesamiento neuronal de las imagenes, algo que Kanemura ha investigado en su pasado académico.

Básicamente, está tratando de imitar el concepto de pensamiento humano en una red de “neuronas” digitales para procesar la información digital. Y así es como se le enseña a un ordenador a diferenciar una “mesa” de otro objeto: dejando que piense por él mismo, en lugar de decirle nosotros lo que tiene que ver. Esto también es correr antes que gatear.

Tampoco se nos debe olvidar algo importante: No nos tenemos que limitar a representar una información digital. ¡Podemos manipular dicha información! Presentémosla, representémosla cómo nosotros queramos. Pero, mejor todavía… ¿Porqué no lo combinamos todo?

La Realidad Aumentada también actúa como catalizador de realidad para formas de reconocimiento simple. En las pruebas que ya se están haciendo, y que podéis hacer vosotros ahora mismo en casa con la iSight de vuestro Mac e imprimiendo una figura, se consiguen auténticas maravillas impensables en otro tiempo como ésta:

Lo que habéis visto en el vídeo, por si no lo conocíais antes, es un ejemplo (muy simple, aunque no lo parezca) de una mezcla de reconocimiento de objetos (la cartulina con la figura) y procesamiento 3D en tiempo real acorde con el movimiento de dicha figura.

Como ya os he dicho, el ejemplo anterior es algo simple. Para ejemplo espectacular el de Toyota para publicitar su último coche, por ejemplo. O cómo se las gastan algunos desarrolladores que ya empiezan a ver en ésta tecnología un espectacular campo para desplegar los videojuegos del futuro, como éste de Zombies, por ejemplo.

Y todavía no hemos visto nada

Si tuviera que apostar por un camino, sería por la integración progresiva de la Realidad Ampliada dentro de un dispositivo como el iPhone. Es cierto que Apple no es la primera ni la última en facilitar la expansión de esta tecnología con sus dispositivos, ya que para Android también hay avances muy interesantes.

Sin embargo, Apple tiene una gran posición dentro de este nuevo mundo, gracias al fantástico éxito de la App Store, del magnífico sistema operativo con el que cuenta el iPhone y de un enorme elenco de desarrolladores que seguro publicarán sus trabajos en un dispositivo tan popular como el móvil de Apple.

Si tuviera que definir como será el futuro que veremos dentro de unos años con nuestros iPhones, diría que no hemos visto nada, para todo lo que nos queda por ver.

Y por supuesto, recordaría aquella magnífica cita que reza “Lo que se ve, es una visión de lo invisible“.

Nunca estas palabras fueron más acertadas.

Ver 22 comentarios

22 comentarios

Pedro Aznar

@Alvaro, en absoluto es SPAM! Un comentario totalmente apropiado y un post muy interesante el tuyo ;)

otto.st

Ups, yo había dejado un comentario por acá... Nada Perdo, felicitarte porque me ha gustado mucho la calidad del artículo, lo he disfrutado un montón de principio a fin.

elmuymac

@ Pedro: GRACIAS! por sacarme una sonrisa! q bueno este artículo, acabo de hacer lo de boffswana.com y me ha parecido muy muy chulo, es muy bueno, recomiendo a todos q lo prueben para q se echen unas risas y por lo menos a mí se me pararon los pelos pensando en todo lo q puede venir con esto... Un post de 10 !!!!!

Radioboy

Pedro... ¿esto no lo escribiste el sábado por la noche verdad?

He intentado ejecutar la aplicación del IQ pero no me funciona :(

KrB

Uso de la camara+uso del geolocalizador+aplicar imagenes a "lo que ves" y todo esto en tiempo real, intuyo que llevara un consumo de bateria brutal. Creo que las aplicaciones que se le pueden dar al iphone son infinitas por capacidades tecnicas pero no son muy "practicas" por la capacidad de su bateria, un problema que creo que deberian de solucionar.

PD: ya de paso molaria un gadget tipo las gafas de oakley para conectarlo al iphone y poder escuchar musica y a la vez ir viendo esta realidad ampliada.

neoacex

Aunque parezca un tanto escéptico no creo que llegue a buen puerto; si, me parece muy bien todo el tema al respecto pero combinar todo en un mismo software?¿?¿ quien controlaria lo que apareceria a nuestro alrededor? si fuese por temas como comentan por aqui de rutas turisticas o restaurantes o lo que sea pues si seria mas factible pero todo junto seria un caos y con una cantidad de información desmesurada y sin orden, ya estamos en una sociedad saturada de publicidad, como además de usar un sofware de gps para geolocalizar los anunciantes

Alan Garcia

muy bueno la verdad @Pedro de lo mejor que eh vsito y si lo que solo veiamos en peliculas prox en nuestras manos jeje

saludos

Alvaro

Precisamente hablando sobre el tema de la realidad aumentada, el otro día escribí un post con una video review que hice de otra aplicación de AR, Robotvision. Espero que no consideréis como spam si pongo el enlace, pero tiene que ver totalmente con el tema. http://savethegeek.blogspot.com/2009/09/video-revi...

Alvaro

Me alegro de que te haya gustado el post :) He estado intercambiando tweets con el desarrollador de la aplicación, ya que no funciona muy bien en España, y me ha dicho que no lo sabía y que lo tendrá en cuenta para futuras actualizaciones. A ver si es cierto!

Saludos!

ngaruti

Es bastante impresionante esta tecnología... ya me imagino en lo que se puede convertir en 5 años más. Me recuerda algunas películas de ciencia ficción jajaja.

Saludos.

erzetan

estoy con el comentario de #6,la publicidad tan bien se va a ver muy implementada

oleurud

La realidad aumentada ya está bastante avanzada y por su puesto es independiente de los moviles. Son necesarios (como mínimo) una serie de componentes para ello: una cámara de video, una pantalla y un procesador de información. Y el mvil es un dispositivo q casi todos tenemos con los tres factores, por lo que provablemente vayan por ahí los comienzos.

Lo de la publicidad, no veo la obligatoriedad. Por ejemplo, un programita de realidad aumentada que permita en Madrid ver las casas que están en alquiler mientras andas por al calle. Este programa será de una agencia inmobiliaria y no creo que tenga otro interés que el propio alquiler. Si por el contrario la aplicación fuera sobre "Ruta turistica por Madríd", estonces seguro que sí.

Os dejo otro post muy interesante ;)

http://oleurud.es/2009/09/09/realidad-aumentada/

oleurud

Perdón, quería poner "proBablemente", que duele a la vista...

qulon

Interesante que coincidan hoy dos de mis blogs de lectura diaria:

http://www.kirainet.com/sekai-camera/

Salu2

Supereloyo

Este tema parece ciencia ficción pero lo tenemos ya aquí. Si son capaces de implementarlo junto con unas gafas que puedan mostrar información digital, entonces ya podremos jugar a ser Son Goku, o a ver como lo hacía Terminator o Robocop, y mil cosas más. El futuro es ayer!

Toni M

neoacex:

filtro/buscador con reconocimiento de voz: le dices al móvil: pisos de alquiler, restaurantes, tiendas de ropa, y te los va filtrando, solo mostrando esa información.

Alvaro

He estado probando una aplicación de las que se hablan en el post y he subido otra video review, es Nearest Places de acrossair. Funciona genial en España, es una gozada! http://savethegeek.blogspot.com/2009/09/video-revi...

jmartitorrent

Felicidades Pedro! Un fantástico artículo, de veras! Increíble!

Nos has abierto los ojos, ei, GENIAL!

mrsmithvlc

Espectacular entrada, un tema francamente fascinante. Enhorabuena.

Heurístico

Desde luego, Apple ha acertado en incorporar la brújula al iPhone 3GS. Si no, se habría quedado rezagada en la implementación de estas aplicaciones que tanto prometen.

Pedro, el artículo es interesante pero falta mencionar algo importante: el acelerómetro. Para saber hacia dónde mira el teléfono es necesario el GPS (determina desde qué punto se mira), la brújula... y también el acelerómetro. Por ejemplo, en la aplicación sobre el metro de Nueva York, es necesario el acelerómetro para saber si el teléfono mira hacia el suelo o hacia arriba, y así mostrar la información que corresponde.

Saludos.